Googleは自然な音声を生成可能な音楽AI「AudioLM」を開発中

Googleの研究者のグループは、数秒間の音声プロンプトを提出すれば、それの続きとなる自然な音声と音楽を作成できる「AudioLM」と呼ばれる新しいAIシステムを開発しました。

このAudioLMはスピーチの続きや、短いピアノフレーズの続きを人間の手を加えることなく、オリジナルとほぼ同じ品質で生成することができます。

既存のAI音楽生成サービスとの違い

AIによって生成される音声は目新しいものではなく、音声が自然言語処理を使用するスマホに搭載されている「Siri」やホームアシスタントの「Alexa」などで広く使用されています。

また、ニューラルネットワークを使用するOpenAIの「Jukebox」のようなAI音楽システムでは、様々なジャンルやアーティスト風に歌声を含んだ生のオーディオを生み出すことができます。

とはいえ、既存のAI技術のほとんどは書き起こしを準備して、テキストベースのトレーニングデータを提出する必要があり、かなりの時間がかかります。

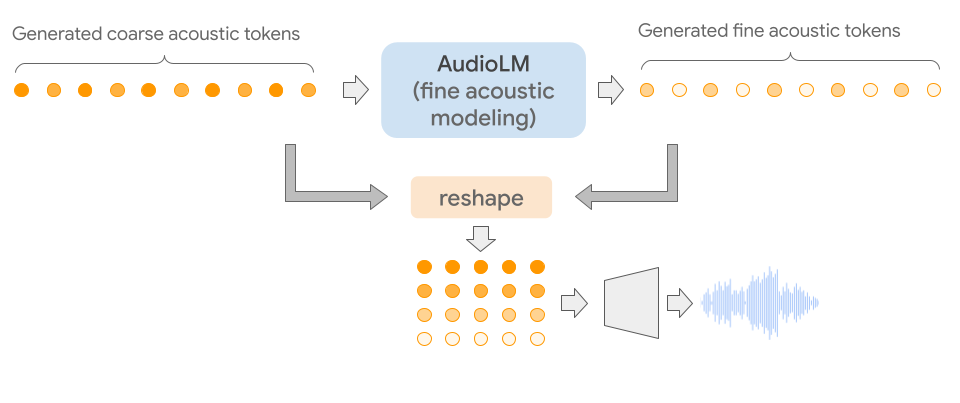

AudioLMでは文字起こしやラベル付けは必要なく、サウンドデータベースがプログラムに入力され、AI学習を使用してオーディオファイルが音の「トークン」と呼ばれるサウンドスニペットに圧縮されます。このトークン化されたトレーニングデータを学習モデルに入力し、マッピングすることで自然言語処理を使用してオーディオパターンを学習します。

より自然な音声を出力

AudioLMは数秒の音声を入力するだけで、次にどういったフレーズがくるのかを予測し、オリジナルと区別がつかないほどの高品質な音声を出力します。

このプロセスは、Generative Pre-trained Transformer 3 (GPT-3) による深層学習を使用して人間のようなテキストを生成する自己回帰言語モデルによって、一般的にどういった単語と文章が続くかを予測する方法と非常によく似ています。

実際に公式ページで、そのクオリティの高さを確認できます。

https://google-research.github.io/seanet/audiolm/examples/

楽器にも対応

AudioLMはスピーチ以外にも、ピアノのような複雑なオーディオデータにも対応しています。

AudioLMによって生成されたピアノ音楽が、通常のAI技術を使用して生成された混沌とした音楽よりもはるかに現実的で流動的に聞こえることが確認できます。

これまでの音楽生成プログラムよりもはるかに優れた音質を備えていること、特にメロディー、ハーモニー、トーン、リズムにおいて、固有の繰り返しパターンの一部を再現することに驚くほど優れた能力を発揮します。

このようにAudioLMは固有の構造を複数のレベルで学習し、ピアノの鍵盤を弾いたときの各音に含まれる微妙な音の揺れやリズム、ハーモニーをキャプチャすることで、リアルなピアノ音楽を作成できます。

一般公開はしない予定?

GoogleによるとAudioLMはあくまで研究目的であり、現時点では広く公開する予定はないと強調しています。しかし、将来的にこういった技術が一般に広く公開された際には、ネット上の発言の信用性は下がり、AIが生成した音楽コンテンツの著作権についての議論が上がることが予想されます。

また、こういった技術が悪用された場合に、数秒でその人と同じような声色で、文章の先を予測して生成できることから、本人の発言なのかAIが生成したものなのかの区別がつかなくなることが大きな問題となりそうです。

AIが社会に与える影響

こういったAI創作物の取り扱いについては、イギリスのスタートアップ企業「Stability AI」公開したオープンソースの画像生成AI「Stable Diffusion」で生成された画像が一般公開されたことで、世界中で大きな注目が集まりました。

巨大なテック企業はすでにこういった高度なAI技術を持っていましたが「社会に対する影響が大きすぎる為、リリースを控えていた」という状況のなか、このような技術を大企業が独占するのはよくないという理由から、スタートアップ企業が一般リリースに踏み切ったという流れです。

パンドラの箱を空けた結果、こぞって世界中のテック企業もあとに続くようにAIサービスを公開する形となり、ここ数か月で画像生成だけでなく、動画、音楽、ゲーム等、さまざまな分野でAIが活用されるようになりました。

もちろん、一番大きな影響を受けるのはアーティストやクリエイターといった専門的な職を持つ人達です。

クリエイターの仕事が無くなる?

「AIに仕事を奪われる!」とネガティブな主張もよく見ますが、これからはAIが得意とすることと、人が得意とする分野を理解して、補完しあうことでより新しいクリエイティブな作品が生まれてくる可能性があります。

BGMやイメージ画像のような"代替えのきく創作物"はほとんどAI生成に移り変わり、アーティストによる独自性の高い作品や、ライブパフォーマンスはまだしばらくは続くと予想されます。

ピアノの作曲の場合、AIであれば指が100本なければ弾けない難しい曲を作ることは簡単です。ただ、ライブパフォーマンスの場合は腕が2本という制約と、アーティストが目の前で演奏している空間を通して、オーディエンスは感動することができます。

こういった物理的な制約であったり、作品におけるアーティストとしての付加価値が“人間らしさ”を担保しており、AIは本質的にそれらを表現することはできません。

しかし、最近のニュースでAIボーカルを使った楽曲が1億回再生を突破!最新の音声合成技術「Lingyin Engine」の記事でも触れたように、いずれは人かAIか分からないレベルの機械学習による“人間らしさ”の表現も可能になっていくことでしょう…

AudioLM