【音楽生成AI】Metaの自動音楽生成ツール「MusicGen」が一般に向けて公開

Metaは、テキストプロンプトやメロディーを使用して調整できる人工知能(AI)音楽生成システムであるMusicGenを発表しました。これはGoogleのMusicLMに似ており、口笛を吹いたり、ハミングしたり、歌ったり、楽器で演奏したりする既存のメロディーを基にして生成することができます。

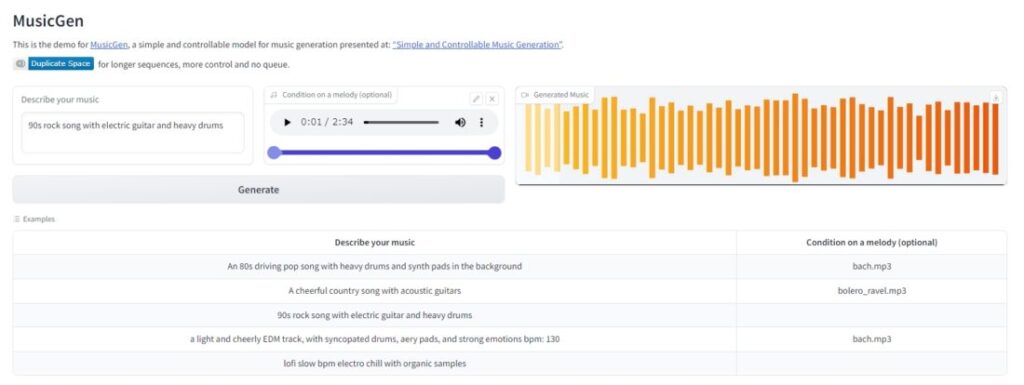

MusicGenはオープンソース化されており、テキストによる説明入力(例えば、バックグラウンドで重いドラムとシンセ パッドを使用した80年代のドライブ用のポップソング)すると約12秒のオーディオが生成されます。

さらに、MusicGenでは既存の曲からメロディーの候補となる音源を参照することが可能で、テキストによる入力と合わせて出力することができます。

MusicGenの仕組み

Metaによると、MusicGenは20,000時間の音楽でトレーニングされており、その中には10,000の高品質なライセンス音楽トラックと、ShutterStockという大規模なストックメディアライブラリであるPond5からの390,000の楽器のみのトラックが含まれているとのことです。

モデルのトレーニングに使用されたコードは提供されていませんが、適切なハードウェア(主に約16GBのメモリを搭載したGPU)を持っていれば、誰でも実行できる事前トレーニング済みモデルを提供しています。

現状は、人間のミュージシャンが職を失うほどの能力を持っているわけではありません。生成される曲は基本的にはシンプルなものが多く、GoogleのAI音楽ジェネレーターであるMusicLMとほぼ同等(わずかに優れている気がします。)です。

実際に使ってみた

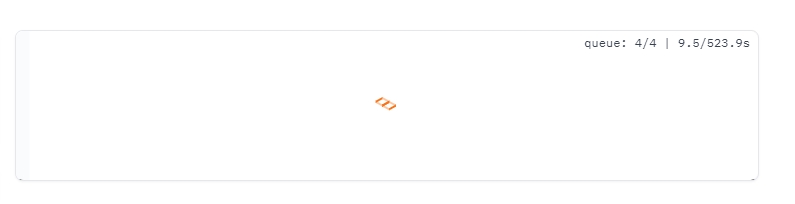

テキスト指示で「エレキギターとヘヴィドラムを使った90年代ロックソング」と参照するメロディー音源を使って生成したところ、15秒のオーディオを作成するのに520秒ほどかかりました。

音楽のクオリティは、テキストプロンプトをかなり正確に反映されているように思います。イメージした通りの音楽が生成されたので、驚きました。

現状は、システムなのかアクセスが集中しているのかはわかりませんが、意外と時間がかかるなといった印象を受けました。おそらく今後改善されることが予想されますが、初期の頃のStable Diffusionのようなもどかしさを感じます。

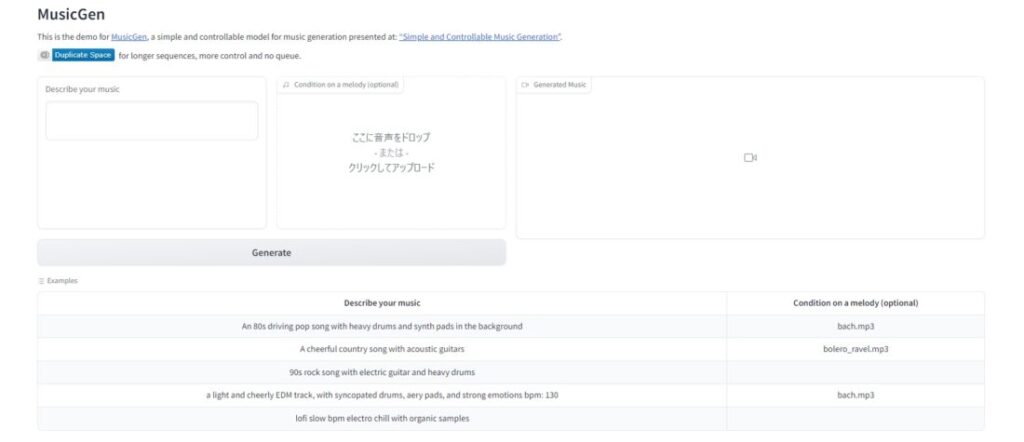

続いて、「アコースティックギターを使った柔らかいカントリーソング」でメロディーは有名な「ボレロ」を参照してみました。

日本の80年代の歌謡曲のような懐かしい感じになりました。

アコースティックギターとボレロのメロディーを微かに感じるので、正確に反映されている印象を受けます。

音楽生成AIの懸念点

AI生成音楽のトラブルは多く、倫理的および法的問題が解決されたわけではありません。MusicGenのような生成モデルは、既存の音楽から「学習」して同様の楽曲を生み出すことができますが、すべてのアーティストや音楽業界がこの技術に納得しているわけではありません。

最近では、ビートルズのポール・マッカートニーが故ジョン・レノンの声をAI生成して、未発表の楽曲をリリースする予定ですが、これにも業界や音楽ファンを含めて賛否の声があります。

→【ビートルズ復活!?】ポール・マッカートニーがAI技術を使って「最後」の未発表曲を制作

また、音楽レーベルは知的財産上の懸念を理由に、ストリーミングサービスに警告を発しており、AI楽曲が削除されるといった事例もあります。このように、音楽生成AIに関連するトラブルは多いので、特に営利目的として使用する場合は注意が必要です。